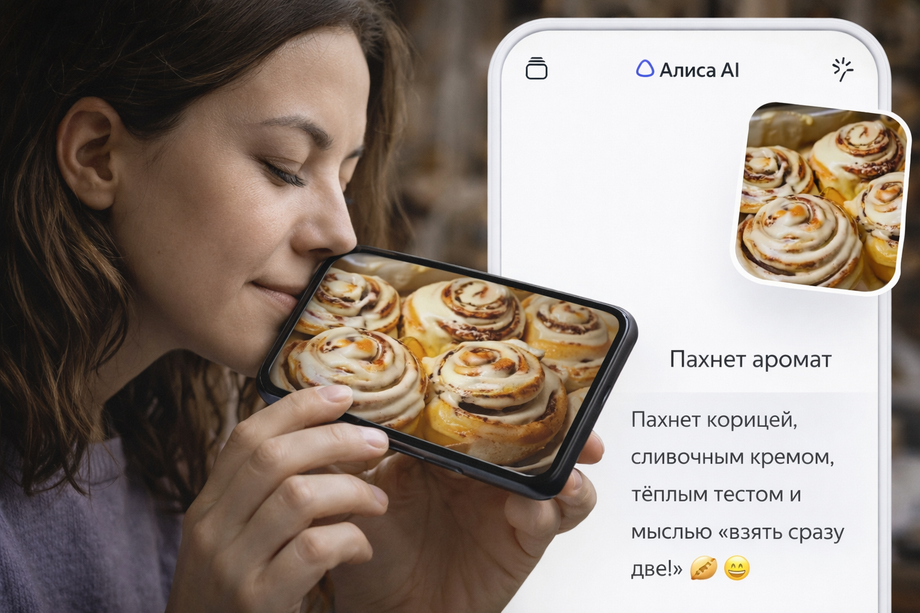

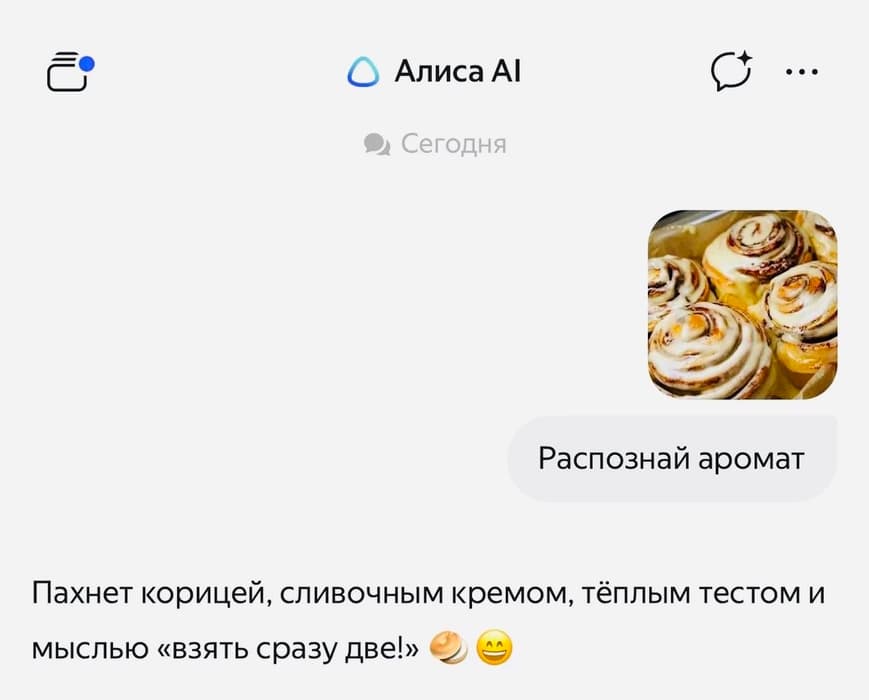

Теперь картинки можно не только смотреть — их можно «почувствовать». В «Алисе AI» от «Яндекса» появилась экспериментальная функция, которая описывает запах по фотографии. В компании подчёркивают, что это первая подобная функциональность среди нейросетей.

Работает просто: загружаешь фото — и нейросеть пытается определить, чем оно «пахнет». Причём речь не только о конкретных объектах, но и об атмосфере. Загородный дом превращается в «лето, трава и домашняя выпечка», а офис — в «кондиционер, бумага и мысли о перерыве».

В основе — анализ визуальных деталей: цвета, текстуры, объектов и общего контекста сцены. На их базе «Алиса» подбирает ассоциации и формирует описание, передавая запах через текст.

Функция доступна в формате ограниченного бета-теста с 1 по 3 апреля. Попробовать её можно в приложениях «Алисы AI», веб-версии, «Яндекс Браузере» и «Поиске с Алисой».

Пока это выглядит как эксперимент, но направление очевидно: нейросети постепенно выходят за рамки привычного восприятия и начинают работать с тем, что раньше считалось исключительно человеческим опытом.

Читайте ещё материалы по теме: