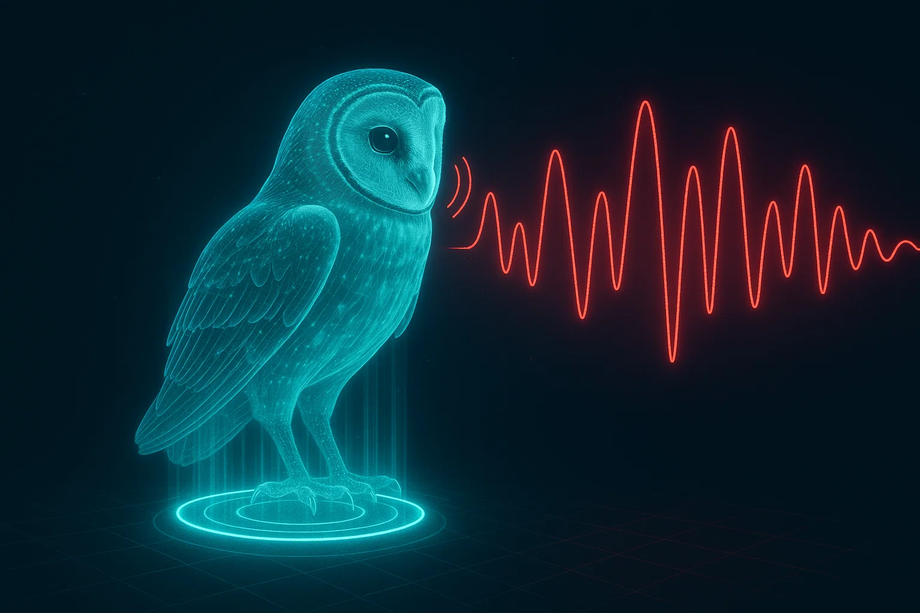

Сотрудники и студенты кафедры криптологии и кибербезопасности НИЯУ МИФИ создали систему «Сипуха», способную определять поддельные аудиозаписи (голосовые дипфейки). Проект, разработанный под руководством доцента Дмитрия Ефанова, победил в конкурсе «Новатор Москвы».

Система основана на нейросети, обученной на более чем 200 тыс. аудиозаписей, включая как реальные голоса, так и дипфейки, сгенерированные разными алгоритмами. Анализ проводится с помощью кепстральных коэффициентов — математических характеристик звука, вычисляемых для коротких фрагментов записи.

Разработка началась в 2022 году как научный проект при поддержке Фонда содействия инновациям. К 2024 году технология стала востребованной из-за роста числа мошенничеств с поддельными голосами. «Сипуха» вошла в число финалистов акселератора МИФИ и «Росатома».

Сейчас команда работает над облачным сервисом для интеграции системы в колл-центры и мессенджеры. Интерес к проекту проявили компании «ТБанк» и «Информзащита». В дальнейшем планируется создать лабораторию для постоянного улучшения алгоритмов. Разработчики рассчитывают на поддержку Правительства Москвы.

Читайте ещё материалы по теме:

ИИ-фейки не пройдут: сервис для маркировки созданного с помощью нейросетей контента создают в России

Нейросети показывают высокую уникальность: более 80% сгененированных текстов проходят проверку

Сделано ИИ: маркировку сгенерированных нейросетью продуктов предложили ввести в России