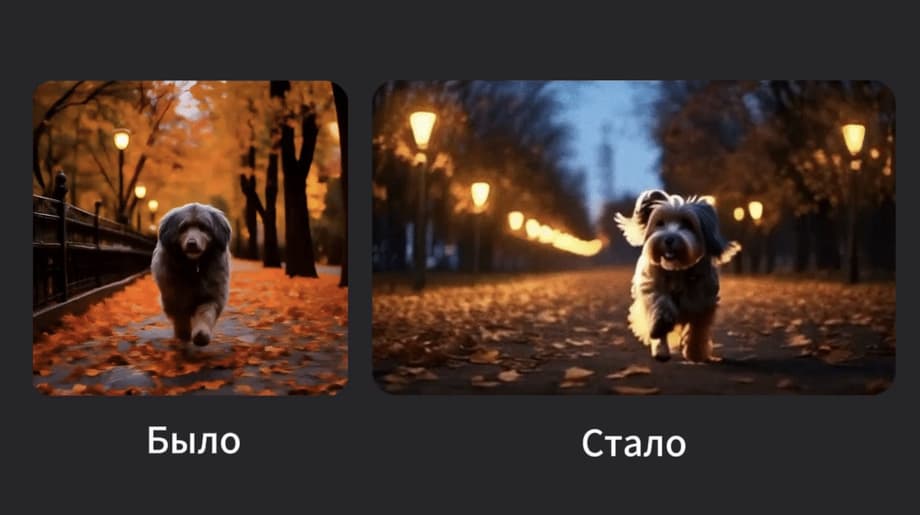

Yandex ha presentado la versión beta de su nueva red neuronal YandexART (Vi), que ahora puede crear videos cortos con objetos en movimiento, con una duración de hasta cinco segundos. A diferencia de las versiones anteriores, que creaban animaciones con la cámara fija, el nuevo modelo es capaz de recrear movimientos realistas y fluidos de objetos, como la carrera de un perro, la caída de una hoja o fuegos artificiales.

YandexART (Vi) permite a los usuarios crear introducciones animadas y contenido de video únicos. También será útil para blogueros, animadores y creadores de contenido. El modelo ya está disponible en la aplicación Shedevrum.

Las versiones anteriores de YandexART generaban animaciones en las que solo se movía el fondo o la cámara, y los objetos cambiaban mucho entre fotogramas. La nueva versión supera estas limitaciones, creando videos más completos y realistas gracias al aprendizaje a partir de ejemplos de movimientos reales, como un coche que pasa o un gato que se mueve.

El proceso de creación de video comienza con una descripción de texto del usuario, por ejemplo, «Un rinoceronte baila hip-hop en un bosque crepuscular». A partir de esta descripción y una imagen inicial, la red neuronal forma gradualmente una secuencia de fotogramas, transformando el ruido digital en un video fluido.

Lea también sobre el tema:

Las redes neuronales de Yandex ahora encuentran a los estafadores siete veces más rápido